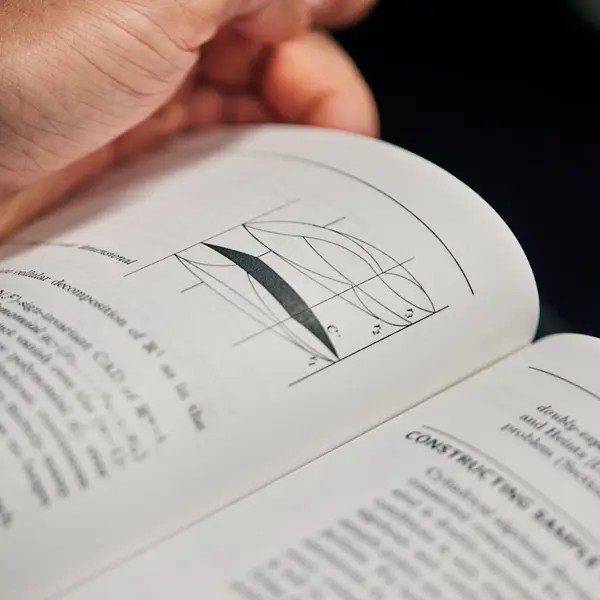

De matematiska vetenskaperna utforskar de grundläggande begreppen och lagarna som formar vårt sätt att tänka – från abstrakta strukturer till konkreta modeller av verkligheten. Matematiken är central för naturvetenskap och teknik, men också viktig inom bland annat samhällsvetenskap, ekonomi, medicin. Matematik är ett forskningsområde med egna teorier, metoder och frågeställningar, och grundforskning inom matematik och statistik är avgörande för framtidens innovationer – ofta långt innan tillämpningarna blir synliga i samhället.

Institutionen för matematiska vetenskaper är gemensam för Göteborgs universitet och Chalmers tekniska högskola och utgör en stark och dynamisk miljö där forskning, utbildning och samverkan med samhället möts.