Forskningsområden

Chalmers forskning samlar kompetens från flera institutioner och fokuserar på globala samhällsutmaningar.

Publikationer och projekt

I research.chalmers.se hittar du information om Chalmers forskning, projekt, personer och publikationer.

Vi utbildar nya forskare

Chalmers erbjuder en attraktiv och konkurrenskraftig forskarutbildning i en stark internationell forskningsmiljö.

Centrum

Våra centrumbildningar samlar kompetens inom olika specialområden i samverkan med akademi, det offentliga samhället och näringslivet. Här listar vi dem alla.

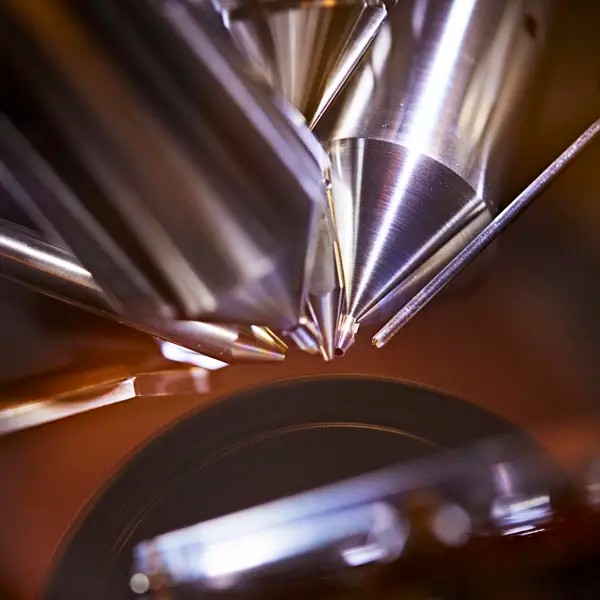

Forskningsinfrastruktur

Begreppet forskningsinfrastruktur omfattar allt från påkostade forskningsanläggningar och avancerade labb – virtuella eller verkliga – till testbäddar, stora databaser eller datorkapacitet för storskaliga beräkningar. Kort sagt, det som behövs för att bedriva riktigt framstående forskning.